Key Takeaways

- Vòng lặp phản hồi AI xảy ra khi đầu ra của một hệ thống AI được dùng làm dữ liệu đầu vào cho hệ thống AI khác, dẫn đến khuếch đại sai sót.

- “Ảo giác” AI là hiện tượng máy móc tạo ra thông tin sai lệch một cách tự tin, gây khó khăn trong việc phát hiện và sửa chữa.

- Vòng lặp phản hồi AI có thể gây ra hậu quả nghiêm trọng trong các ngành như tài chính, y tế và thương mại điện tử.

- Để giảm thiểu rủi ro, cần sử dụng dữ liệu huấn luyện chất lượng cao và đa dạng, kết hợp giám sát của con người và kiểm toán thường xuyên.

- Các công cụ phát hiện lỗi AI và thuật toán tự sửa lỗi là những hướng đi tiềm năng để quản lý vòng lặp phản hồi AI.

Trí tuệ nhân tạo (AI) đang ngày càng trở thành trụ cột trong vận hành và nâng cao trải nghiệm khách hàng của nhiều doanh nghiệp. Tuy nhiên, song hành với sức mạnh vượt trội, AI cũng tiềm ẩn một rủi ro khó lường: vòng lặp phản hồi AI. Hiện tượng này xảy ra khi các hệ thống AI được huấn luyện dựa trên dữ liệu đầu ra từ chính các mô hình AI khác, vô tình “nuôi dưỡng” và khuếch đại những sai sót tiềm ẩn.

Vòng lặp phản hồi AI: “Con dao hai lưỡi” của Trí tuệ Nhân tạo

Vòng lặp phản hồi AI, hay AI feedback loop, là một khái niệm đang thu hút sự chú ý đặc biệt trong giới công nghệ. Nó mô tả một quy trình tưởng chừng như vô hại nhưng lại ẩn chứa nhiều nguy cơ.

Vòng lặp phản hồi AI là gì và cơ chế hoạt động?

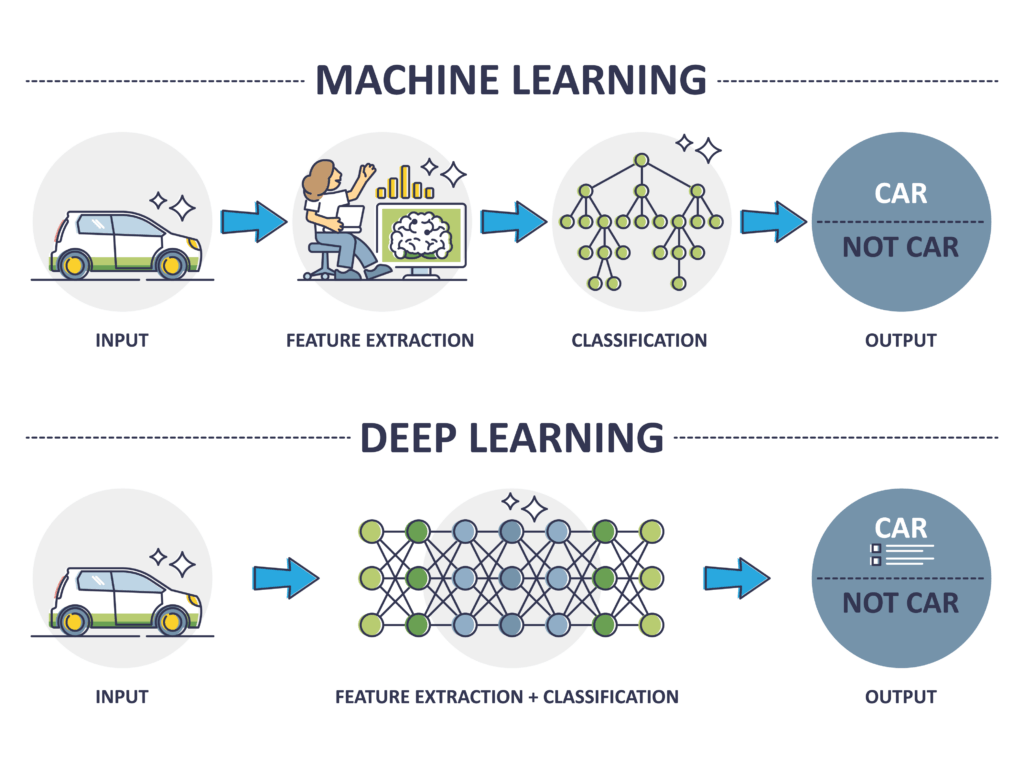

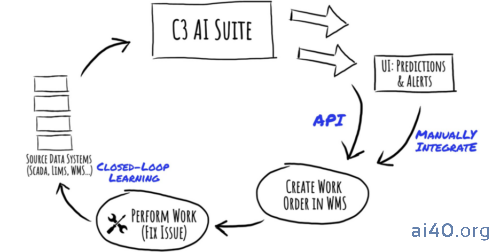

Về cơ bản, vòng lặp phản hồi AI xuất hiện khi đầu ra của một hệ thống AI này được sử dụng làm dữ liệu đầu vào để huấn luyện một hệ thống AI khác. Quá trình này rất phổ biến trong học máy (machine learning), nơi các mô hình liên tục “học hỏi” từ lượng lớn dữ liệu để đưa ra dự đoán hoặc tạo ra kết quả.

Tuy nhiên, vấn đề nảy sinh khi đầu ra của một mô hình AI bị “nhiễm” lỗi. Những lỗi này, dù nhỏ đến đâu, cũng có thể được truyền sang và khuếch đại trong các mô hình AI kế tiếp, tạo ra một chu kỳ sai sót ngày càng trầm trọng.

“Mầm mống” sai sót: Khi AI học từ chính AI

Hãy tưởng tượng một mô hình AI được huấn luyện dựa trên nội dung do một AI khác tạo ra. Nếu AI ban đầu hiểu sai một chủ đề hoặc cung cấp thông tin không chính xác, những sai lầm này sẽ trở thành một phần của dữ liệu huấn luyện cho AI thứ hai. Khi quy trình này lặp lại, các lỗi sẽ tích tụ, khiến hiệu suất của hệ thống suy giảm theo thời gian và việc xác định, sửa chữa các điểm không chính xác trở nên vô cùng khó khăn.

Các mô hình AI học hỏi từ lượng dữ liệu khổng lồ để xác định các mẫu và đưa ra dự đoán. Ví dụ, công cụ đề xuất của một trang thương mại điện tử có thể gợi ý sản phẩm dựa trên lịch sử duyệt web của người dùng, tinh chỉnh các đề xuất khi xử lý nhiều dữ liệu hơn. Tuy nhiên, nếu dữ liệu huấn luyện bị lỗi, đặc biệt nếu nó dựa trên đầu ra của các mô hình AI khác, nó có thể sao chép và thậm chí khuếch đại những sai sót này.

Trong các ngành như y tế, nơi AI được sử dụng cho các quyết định quan trọng, một mô hình AI thiên lệch hoặc không chính xác có thể dẫn đến những hậu quả nghiêm trọng, chẳng hạn như chẩn đoán sai hoặc đề xuất điều trị không phù hợp. Rủi ro đặc biệt cao trong các lĩnh vực phụ thuộc vào AI cho các quyết định quan trọng, như tài chính, y tế và luật pháp. Trong những lĩnh vực này, lỗi trong đầu ra của AI có thể dẫn đến tổn thất tài chính đáng kể, tranh chấp pháp lý hoặc thậm chí gây hại cho cá nhân.

“Ảo giác” AI: Khi máy móc “sáng tạo” ra sự thật không tồn tại

Một trong những biểu hiện đáng lo ngại của vòng lặp phản hồi AI chính là hiện tượng “ảo giác” AI (AI hallucinations). Đây là tình trạng máy móc tạo ra kết quả đầu ra có vẻ hợp lý nhưng hoàn toàn sai lệch hoặc bịa đặt.

Nguyên nhân dẫn đến hiện tượng “ảo giác” AI

Hiện tượng “ảo giác” AI xảy ra khi một cỗ máy tạo ra kết quả đầu ra có vẻ hợp lý nhưng hoàn toàn sai sự thật. Ví dụ, một chatbot AI có thể tự tin cung cấp thông tin bịa đặt, chẳng hạn như một chính sách công ty không tồn tại hoặc một số liệu thống kê tự chế. Không giống như lỗi do con người tạo ra, “ảo giác” AI có thể xuất hiện rất có thẩm quyền, khiến chúng khó bị phát hiện, đặc biệt khi AI được huấn luyện trên nội dung do các hệ thống AI khác tạo ra.

Nguyên nhân của “ảo giác” AI có thể bắt nguồn từ nhiều yếu tố. Một vấn đề chính là khi các hệ thống AI được huấn luyện trên dữ liệu từ các mô hình AI khác. Nếu một hệ thống AI tạo ra thông tin không chính xác hoặc thiên lệch, và đầu ra này được sử dụng làm dữ liệu huấn luyện cho một hệ thống khác, lỗi sẽ được chuyển tiếp. Theo thời gian, điều này tạo ra một môi trường nơi các mô hình bắt đầu tin tưởng và lan truyền những thông tin sai lệch này như dữ liệu hợp pháp.

Ngoài ra, các hệ thống AI phụ thuộc rất nhiều vào chất lượng dữ liệu mà chúng được huấn luyện. Nếu dữ liệu huấn luyện bị lỗi, không đầy đủ hoặc thiên lệch, đầu ra của mô hình sẽ phản ánh những điểm không hoàn hảo đó. Ví dụ, một bộ dữ liệu có thành kiến về giới tính hoặc chủng tộc có thể dẫn đến việc các hệ thống AI tạo ra các dự đoán hoặc đề xuất thiên lệch. Một yếu tố góp phần khác là overfitting (quá khớp), nơi một mô hình trở nên quá tập trung vào các mẫu cụ thể trong dữ liệu huấn luyện, khiến nó có nhiều khả năng tạo ra kết quả đầu ra không chính xác hoặc vô nghĩa khi đối mặt với dữ liệu mới không phù hợp với các mẫu đó.

“Ảo giác” AI và những hệ lụy khó lường trong thực tế

Trong các tình huống thực tế, “ảo giác” AI có thể gây ra các vấn đề nghiêm trọng. Ví dụ, các công cụ tạo nội dung do AI điều khiển như GPT-3 và GPT-4 có thể tạo ra các bài báo chứa trích dẫn bịa đặt, nguồn giả mạo hoặc thông tin sai sự thật. Điều này có thể làm tổn hại đến uy tín của các tổ chức dựa vào các hệ thống này.

Tương tự, các bot dịch vụ khách hàng do AI cung cấp có thể đưa ra các câu trả lời gây hiểu lầm hoặc hoàn toàn sai, dẫn đến sự không hài lòng của khách hàng, làm xói mòn niềm tin và tiềm ẩn rủi ro pháp lý cho doanh nghiệp.

Vòng lặp phản hồi “khuếch đại” sai lầm: Doanh nghiệp đối mặt rủi ro

Nguy cơ của vòng lặp phản hồi AI nằm ở khả năng khuếch đại các lỗi nhỏ thành các vấn đề lớn. Khi một hệ thống AI đưa ra dự đoán không chính xác hoặc cung cấp đầu ra bị lỗi, sai lầm này có thể ảnh hưởng đến các mô hình tiếp theo được huấn luyện trên dữ liệu đó.

Tác động nghiêm trọng đến các ngành chủ chốt

Khi chu kỳ này tiếp tục, các lỗi được củng cố và phóng đại, dẫn đến hiệu suất ngày càng kém. Theo thời gian, hệ thống trở nên “tự tin” hơn vào những sai lầm của mình, khiến việc giám sát của con người khó phát hiện và sửa chữa hơn.

Trong các ngành như tài chính, y tế và thương mại điện tử, vòng lặp phản hồi có thể gây ra những hậu quả nghiêm trọng trong thế giới thực. Ví dụ, trong dự báo tài chính, các mô hình AI được huấn luyện trên dữ liệu bị lỗi có thể tạo ra các dự đoán không chính xác. Khi những dự đoán này ảnh hưởng đến các quyết định trong tương lai, các lỗi sẽ gia tăng, dẫn đến kết quả kinh tế yếu kém và tổn thất đáng kể.

Trong thương mại điện tử, các công cụ đề xuất AI dựa trên dữ liệu thiên lệch hoặc không đầy đủ có thể cuối cùng lại quảng bá nội dung củng cố các khuôn mẫu hoặc thành kiến. Điều này có thể tạo ra các “buồng vang” (echo chambers), phân cực khán giả và làm xói mòn niềm tin của khách hàng, cuối cùng gây tổn hại đến doanh số và danh tiếng thương hiệu.

Tương tự, trong dịch vụ khách hàng, các chatbot AI được huấn luyện trên dữ liệu bị lỗi có thể cung cấp các phản hồi không chính xác hoặc gây hiểu lầm, chẳng hạn như chính sách hoàn trả không chính xác hoặc chi tiết sản phẩm bị lỗi. Điều này dẫn đến sự không hài lòng của khách hàng, làm xói mòn niềm tin và các vấn đề pháp lý tiềm ẩn cho doanh nghiệp.

Trong lĩnh vực y tế, các mô hình AI được sử dụng để chẩn đoán y tế có thể lan truyền lỗi nếu được huấn luyện trên dữ liệu thiên lệch hoặc bị lỗi. Một chẩn đoán sai do một mô hình AI đưa ra có thể được truyền lại cho các mô hình trong tương lai, làm trầm trọng thêm vấn đề và gây nguy hiểm cho sức khỏe của bệnh nhân.

“Giải mã” cạm bẫy: Chiến lược giảm thiểu rủi ro từ vòng lặp phản hồi AI

Để giảm thiểu rủi ro từ vòng lặp phản hồi AI, doanh nghiệp có thể thực hiện một số bước nhằm đảm bảo các hệ thống AI vẫn đáng tin cậy và chính xác.

Vai trò của dữ liệu chất lượng và đa dạng

Đầu tiên, việc sử dụng dữ liệu huấn luyện đa dạng, chất lượng cao là điều cần thiết. Khi các mô hình AI được huấn luyện trên nhiều loại dữ liệu, chúng ít có khả năng đưa ra các dự đoán thiên lệch hoặc không chính xác có thể dẫn đến việc các lỗi tích tụ theo thời gian.

“Người gác cổng” HITL: Giám sát của con người là then chốt

Một bước quan trọng khác là kết hợp sự giám sát của con người thông qua các hệ thống Human-in-the-Loop (HITL). Bằng cách để các chuyên gia con người xem xét các kết quả đầu ra do AI tạo ra trước khi chúng được sử dụng để huấn luyện các mô hình tiếp theo, doanh nghiệp có thể đảm bảo rằng các sai lầm được phát hiện sớm. Điều này đặc biệt quan trọng trong các ngành như y tế hoặc tài chính, nơi độ chính xác là cực kỳ quan trọng.

Kiểm toán thường xuyên và công cụ phát hiện lỗi

Việc kiểm toán thường xuyên các hệ thống AI giúp phát hiện sớm các lỗi, ngăn chúng lan truyền qua các vòng lặp phản hồi và gây ra các vấn đề lớn hơn sau này. Các cuộc kiểm tra liên tục cho phép doanh nghiệp xác định khi có sự cố xảy ra và thực hiện các biện pháp khắc phục trước khi vấn đề trở nên quá phổ biến.

Các doanh nghiệp cũng nên xem xét việc sử dụng các công cụ phát hiện lỗi AI. Những công cụ này có thể giúp phát hiện các sai sót trong đầu ra của AI trước khi chúng gây ra tác hại đáng kể. Bằng cách gắn cờ lỗi sớm, doanh nghiệp có thể can thiệp và ngăn chặn sự lan truyền thông tin không chính xác.

Hướng tới tương lai: AI tự sửa lỗi và tính minh bạch

Nhìn về phía trước, các xu hướng AI mới nổi đang cung cấp cho doanh nghiệp những cách mới để quản lý các vòng lặp phản hồi. Các hệ thống AI mới đang được phát triển với các tính năng kiểm tra lỗi tích hợp, chẳng hạn như thuật toán tự sửa lỗi. Ngoài ra, các cơ quan quản lý đang nhấn mạnh đến tính minh bạch cao hơn của AI, khuyến khích các doanh nghiệp áp dụng các biện pháp thực hành giúp hệ thống AI dễ hiểu và có trách nhiệm giải trình hơn.

Bằng cách tuân theo các thông lệ tốt nhất này và cập nhật những phát triển mới, doanh nghiệp có thể khai thác tối đa AI đồng thời giảm thiểu rủi ro. Tập trung vào các thực hành AI có đạo đức, chất lượng dữ liệu tốt và tính minh bạch rõ ràng sẽ là điều cần thiết để sử dụng AI một cách an toàn và hiệu quả trong tương lai.

Kết luận

Vòng lặp phản hồi AI là một thách thức ngày càng gia tăng mà các doanh nghiệp phải giải quyết để khai thác triệt để tiềm năng của Trí tuệ Nhân tạo. Dù AI mang lại giá trị to lớn, khả năng khuếch đại sai sót của nó lại tiềm ẩn những rủi ro đáng kể, từ các dự đoán không chính xác đến gián đoạn kinh doanh nghiêm trọng. Khi các hệ thống AI ngày càng trở nên không thể thiếu trong việc ra quyết định, việc triển khai các biện pháp bảo vệ như sử dụng dữ liệu đa dạng và chất lượng cao, kết hợp sự giám sát của con người và tiến hành kiểm toán thường xuyên là vô cùng thiết yếu. Đây chính là chìa khóa để doanh nghiệp không chỉ “thuần hóa” mà còn làm chủ công nghệ AI, tránh rơi vào “cạm bẫy” của những lỗi tự nhân bản.